图注:在不到一个月的时间里,内置超过2,000个NVIDIA A100 GPU的NVIDIA全新DGX SuperPOD(上图为艺术渲染图)就在市售商用产品中脱颖而出,并在各项针对大规模计算性能的MLPerf基准测试中均取得了优异成绩。

(源初/文)根据昨日发布的MLPerf基准测试结果显示,NVIDIA在全球市售商用产品中,具备全球最快的AI训练性能。

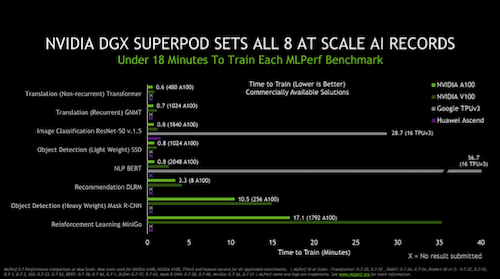

A100 Tensor Core GPU在加速器的全部八项MLPerf基准测试中展现了最快的性能。在实现总体最快的大规模解决方案方面,利用HDR InfiniBand实现多个DGX A100 系统互联的庞大集群--DGX SuperPOD系统在性能上,也开创了八项全新里程碑。当今,能够借助这些高性能的AI技术来更快速、更具成本效益地实现业务转型的客户,将成为最终的获益者。

行业基准测试组织MLPerf成立于2018年5月。此次已是NVIDIA在MLPerf训练测试中连续第三次展现了最强劲的性能。2018年12月,NVIDIA首次在MLPerf训练基准测试中创下了六项纪录,次年7月NVIDIA再次创下八项纪录。

NVIDIA在客户最关心的市售商用产品类别中创下了纪录。NVIDIA在测试中用到的产品基于最新NVIDIA Ampere架构以及Volta架构。

图注:NVIDIA DGX SuperPOD系统为大规模AI训练树立全新里程碑。

NVIDIA是唯一一家在所有测试中均采用市售商用产品的公司。其他大多数提交使用的要么是预览类别(preview category),其所用的产品预计需要几个月后才会面市,要么使用的是研究类别的产品,更是较长一段时间内都不会面市。

NVIDIA Ampere市场采用速度刷新纪录

A100是首款基于NVIDIA Ampere架构的处理器。它不仅打破了性能纪录,其进入市场的速度也比以往任何NVIDIA GPU更快。A100在发布之初用于NVIDIA的第三代DGX系统。正式发布仅六周后,A100就正式登陆了Google Cloud 。

为助力满足市场的强劲需求,AWS、百度云、微软Azure和腾讯云等全球领先的云提供商,以及Dell Technologies、HPE、浪潮和超微等数十家主要服务器制造商,均采用了A100。

全球用户都在使用A100以应对AI、数据科学和科学计算中最为复杂的挑战。

其中有些正在赋能新一代的推荐系统或对话式AI应用,或进一步探索COVID-19的治疗方法,这些都在受益第八代NVIDIA GPU所带来的迄今为止幅度最大的性能提升。

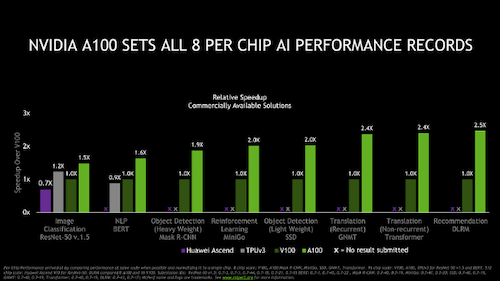

图注:NVIDIA Ampere架构在市售商用加速器的全部八项测试中名列前茅。

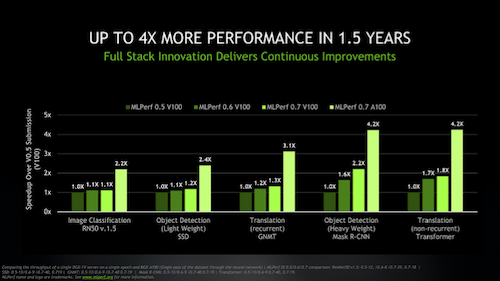

一年半内实现4倍性能提升

最新结果表明,NVIDIA聚焦于不断发展跨处理器、网络、软件和系统的AI平台。

例如,测试结果显示,相较于首轮MLPerf训练测试中使用的基于V100 GPU的系统,如今的DGX A100系统能够以相同的吞吐率,实现高达4倍的性能提升。同时,得益于最新的软件优化,基于NVIDIA V100的DGX-1 系统亦可实现高达2倍的性能提升。

不到两年,整个AI平台的创新就取得了如此优异的成绩。如今,NVIDIA A100 GPU搭配CUDA-X库的软件更新,为通过Mellanox HDR 200Gb/s InfiniBand网络构建的扩展集群注入了强劲动力。

HDR InfiniBand可实现极低的延迟和高数据吞吐量,同时通过可扩展分层聚合和缩减协议(SHARP)技术,提供智能深度学习计算加速引擎。

图注:NVIDIA持续通过全新GPU、软件升级和不断扩展的系统设计,以提升AI性能。

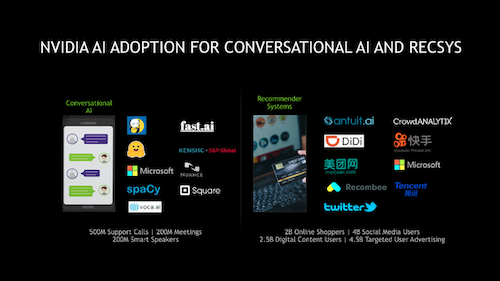

NVIDIA在推荐系统、对话式AI、强化学习领域大放异彩

MLPerf基准测试得到了亚马逊、百度、Facebook、谷歌、哈佛大学、英特尔、微软和斯坦福大学等机构的支持,并跟随AI的发展步伐持续演进。

最新基准测试包含两项新的测试和一项经大幅修订的测试。NVIDIA在这三项测试中均取得了优异的成绩。其中,一项基准测试对推荐系统的性能进行了排名。推荐系统是日益普及的一项AI任务。另一项基准测试对使用BERT的对话式AI进行了测试。BERT是现有最复杂的神经网络模型之一。最后,强化学习测试中使用了Mini-go和全尺寸19x19 围棋棋盘。该测试是本轮最复杂的测试,内容涵盖从游戏到训练的多项操作。

图注:使用面向对话式AI和推荐系统的NVIDIA AI解决方案的客户。

各大公司在这些战略性的AI应用领域已经受益于NVIDIA带来的强大性能。

阿里巴巴在11月的“双十一”期间创造了380亿美元的销售纪录,其推荐系统使用了NVIDIA GPU,使每秒查询量达到了CPU的100倍以上。而对话式AI自身也成为了业界关注的焦点,推动从金融到医疗健康等行业的业务发展。

NVIDIA不仅能为这些庞大工作的运转提供所需的性能,还使其易于使用。

软件为AI的战略发展铺平道路

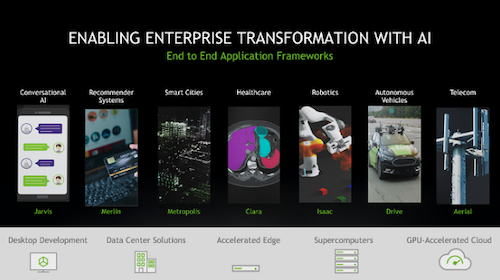

今年五月,NVIDIA发布了两个应用框架——用于对话式AI的Jarvis和用于推荐系统的Merlin。 Merlin中包含了助力最新MLPerf基准测试结果的HugeCTR训练框架。

这些应用框架仅仅是一部分。在不断壮大的应用框架中,还有面向汽车行业市场的NVIDIA DRIVE,面向医疗健康市场的Clara,面向机器人技术市场的Isaac,以及面向零售/智能城市市场的Metropolis。

图注:NVIDIA应用框架简化了企业级AI的开发和部署。

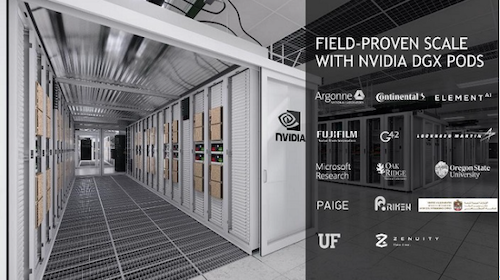

DGX SuperPOD架构兼顾速度与规模

NVIDIA在Selene上运行了系统的MLPerf测试,Selene是基于DGX SuperPOD的内部集群。DGX SuperPOD是针对大规模GPU集群的公共参考架构,可在数周内完成部署。该架构基于DGX POD的设计原理和最佳实践进行了扩展,致力于解决当今AI领域最具挑战性的难题。

Selene最近在TOP500榜单中首次亮相,凭借百亿亿次(exaflops)级别的AI性能,成为美国最快的工业系统。它也是Green500榜单中全球第二大节能系统。

客户已经采用这些参考架构来构建自身的DGX POD和DGX SuperPOD。其中包括美国最快的学术领域AI超级计算机HiPerGator,该超级计算机也将成为佛罗里达大学跨学科AI创新的基石。

同时,全球领先的超算中心Argonne国家实验室正在使用DGX A100,寻找抗击COVID-19疫情的方法。Argonne国家实验室是六个首批采用A100 GPU的高性能计算中心中的先行者之一。

图注:NVIDIA DGX POD的广泛采用。

DGX SuperPOD现已助力汽车领域的大陆集团、航空航天领域的Lockheed Martin和云计算服务领域的微软等公司取得了良好的业务成果。

这些系统的顺利运转,部分得益于其广泛的生态系统对于NVIDIA GPU和DGX支持。

NVIDIA生态系统在MLPerf基准测试中展示傲人成绩

在提交结果的九家公司中,除NVIDIA外还有六家公司提交了基于NVIDIA GPU的测试结果,其中包括三家云服务提供商(阿里云、谷歌云和腾讯云)和三家服务器制造商(戴尔、富士通和浪潮),凸显了NVIDIA生态系统的优势。

图注:采用NVIDIA AI平台参与基准测试的合作伙伴。

这些合作伙伴大多采用了NVIDIA软件中心NGC中的容器,以及用于参赛的公开框架。

包括这些MLPerf合作伙伴在内的近二十家云服务提供商和OEM组成的生态系统,已采用或计划采用NVIDIA A100 GPU来打造在线实例、服务器和PCIe卡。

经测试验证的软件现可从NGC获取

现在,大多数NVIDIA及其合作伙伴在最新MLPerf基准测试中使用的软件,已可通过NGC获取。

NGC中包括多个GPU优化的容器、软件脚本、预训练模型和SDK,可助力数据科学家和开发者在TensorFlow和PyTorch等常用框架上加速AI工作流程。

各机构都在大力采用容器,以加速实现业务成果。毕竟,业务成果才是最终的“基准”。

相关专题:

相关专题: